בטיחות ב-AI: איך לתת גישה לנתונים בלי לחשוף סודות

הסיוט של כל מנהל IT: הסודות שלך, אצל המתחרים

אתם בטח מכירים את הסיפור המפורסם והמפחיד שרץ בלינקדאין ובתקשורת: מהנדס תוכנה בחברה טכנולוגית ענקית (כמו סמסונג או אמזון למשל) רצה בסך הכל לייעל את העבודה שלו. הוא העלה ל-ChatGPT קטע קוד סודי (Proprietary Code) הקשור לפיתוח שבבים עתידיים, או אולי פרוטוקול של ישיבת דירקטוריון רגישה, וביקש מהבוט בשיא התמימות: "תסכם לי את זה", "תמצא לי את הבאג", או "תנסח לי מייל תשובה".

מה שהוא לא ידע, זה שבאותו רגע הוא שלח את הסוד המסחרי הכי כמוס של החברה לשרתים ציבוריים בארצות הברית. יום למחרת, המידע הזה עובד והפך (תיאורטית) לחלק מבסיס הידע של המערכת, ופוטנציאלית יכול היה להופיע בתשובות למשתמשים אחרים – כולל המתחרים הישירים שלו ששאלו שאלות דומות.

זהו הפחד הכי גדול (ובצדק) של מנכ"לים, סמנכ"לי כספים, עורכי דין וארגוני B2B ששוקלים לאמץ טכנולוגיות AI: "אם אני מחבר את הבוט ל-CRM שלי, האם OpenAI או גוגל יקראו את רשימת הלקוחות שלי? האם הדאטה הפיננסי שלי דולף החוצה? האם אני מסכן את הפטנטים שלי?"

התשובה הקצרה היא: תלוי מאוד איך אתם עושים את זה. אם העובדים שלכם משתמשים בגרסה החינמית של ChatGPT באופן פיראטי ופרטיזני – אתם בבעיה חמורה של אבטחת מידע. אבל אם אתם בונים פתרון ארגוני מנוהל דרך API (ממשק תכנות) – אתם יכולים להיות בטוחים לחלוטין. בואו נבין את ההבדל הקריטי הזה לעומק.

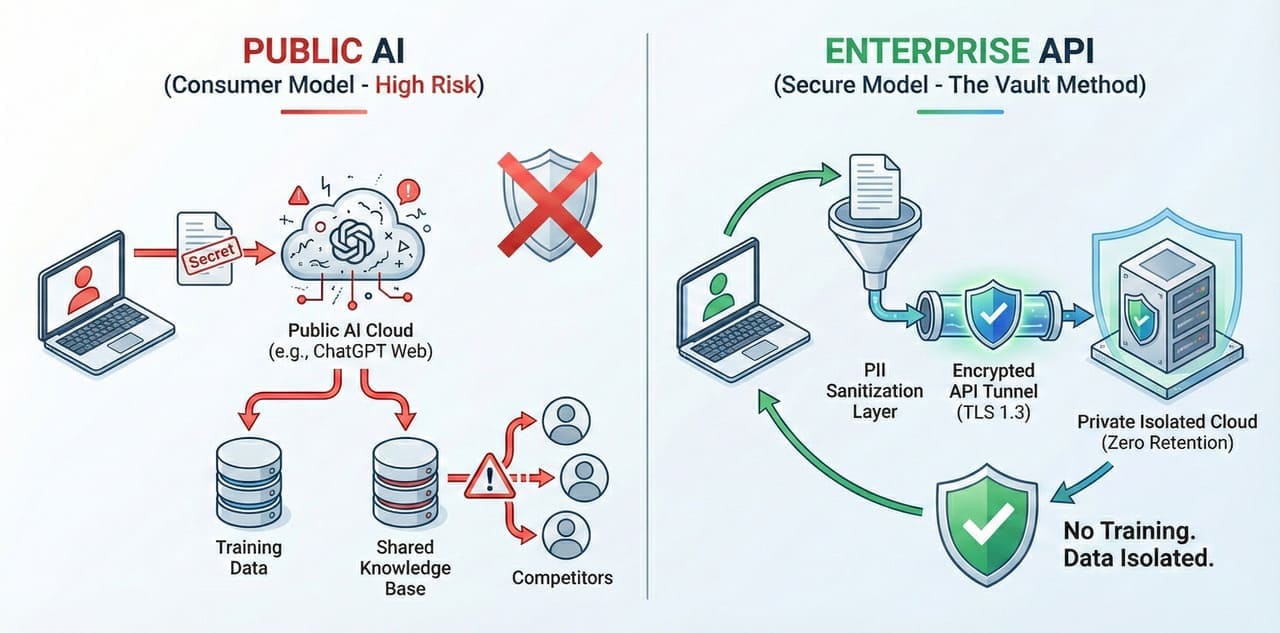

ההבדל בין "Public AI" ל-"Enterprise AI"

כדי להבין אבטחת מידע ב-2026 ולנהל סיכונים נכון, חייבים להבדיל בין שני עולמות נפרדים לחלוטין:

1. המודל הצרכני (Consumer Model - Public)

זה מה שרוב האנשים מכירים (ChatGPT, Claude.ai, Gemini בגרסת ה-Web). אתם נכנסים לאתר, כותבים שאלה, והמידע נשמר על השרתים. המודל העסקי של החברות האלו מבוסס בחלקו על כך שהמידע שלכם עוזר לאמן ולשפר את המודלים הבאים (Training Data).

- רמת אבטחה: נמוכה יחסית לסטנדרטים תאגידיים.

- פרטיות: המידע משמש לאימון המודל.

- למי זה מתאים: לכתיבת ברכה ליום הולדת, למתכונים, לרעיונות לטיול, לשאלות כלליות. אסור בתכלית האיסור להשתמש בזה לניתוח דו"חות כספיים, חוזים משפטיים או מידע רפואי.

2. המודל העסקי (API Enterprise Model)

כשאנחנו ב-Whale Group בונים לכם Consultant Agent או כל פתרון אחר, אנחנו לא משתמשים באתר האינטרנט הפתוח. אנחנו משתמשים ב"צינור" תקשורת ישיר, פרטי ומוצפן לשרתים (API). על פי תנאי השימוש המשפטיים (Terms of Service) המחייבים של ספקיות ה-AI הגדולות (OpenAI Enterprise, Google Vertex AI, Azure OpenAI) בשימוש דרך API:

- Zero Data Retention (אי-שמירת נתונים): המידע שלכם לא נשמר בשרתי הספק לאחר סיום העיבוד.

- No Training (ללא אימון): המידע שלכם לא משמש לאימון המודל העתידי של החברה. הוא שלכם ורק שלכם.

- הפרדה מוחלטת (Isolation): המידע עובר, מעובד, ומוחזר אליכם. הוא לא נכנס ל"מוח הכללי" של ה-AI ולא זולג החוצה למשתמשים אחרים.

רוצים להתייעץ?

אנחנו יכולים לעזור לכם לבחור, לבנות ולהטמיע את הבוט המושלם לעסק שלכם, בין אם בוואטסאפ או באתר. השאירו פרטים ונחזור אליכם.

ארכיטקטורת האבטחה שלנו: "שיטת הכספת" (The Vault Method)

ב-Tech Consulting של Whale Group, אנחנו לא לוקחים סיכונים מיותרים. אנחנו מיישמים ארכיטקטורת אבטחה רב-שכבתית (Defense in Depth) כדי להגן על הנכסים שלכם ולוודא עמידה בתקנים מחמירים (GDPR, SOC2). אנחנו קוראים לזה "שיטת הכספת":

- שכבת הסינון (Sanitization Layer - PII Redaction): לפני שהשאלה של הלקוח בכלל מגיעה ל-AI, היא עוברת דרך אלגוריתם סינון חכם (Redactor) שמוחק אוטומטית פרטים מזהים (PII - Personally Identifiable Information) רגישים כמו מספרי אשראי, תעודות זהות, כתובות פרטיות או סיסמאות, אם הם לא נחוצים לתשובה. כך המידע הרגיש נשאר אצלכם בשרת ולא יוצא החוצה לעולם.

- הקשר מוגבל וחכם (RAG - Retrieval Augmented Generation): הבוט לא "מוריד את כל ה-CRM" או את כל בסיס הנתונים אליו. הוא עובד בשיטה כירורגית. הוא מקבל גישה נקודתית ("Read Only") אך ורק לפיסת המידע הספציפית שרלוונטית לאותה שאלה באותו רגע. למשל, רק לסטטוס ההזמנה של הלקוח הנוכחי, ולא לכל ההזמנות בחברה. זה ממזער את שטח התקיפה משמעותית.

- הצפנה מקצה לקצה (Encryption): כל התקשורת, מהאתר שלכם ועד השרת, ובחזרה, מוצפנת בתקן TLS 1.3 (אותו תקן הצפנה המשמש בנקים, מוסדות פיננסיים וגופי ביטחון). גם אם מישהו יירט את התקשורת בדרך, הוא יראה רק רצף תווים חסר משמעות ("ג'יבריש").

הסכנה האמיתית היא לא ה-AI, אלא ה"צל" (Shadow AI)

מחקרים מראים שהסיכון הגדול ביותר לארגון שלכם היום הוא לא הטמעת AI מסודרת, אלא ההפך ממנה – ההתעלמות. בזמן שאתם מתלבטים ומחכים, העובדים שלכם כבר משתמשים ב-AI "מתחת לרדאר" כדי להקל על העומס שלהם. הם מעתיקים טבלאות אקסל לבוטים חינמיים לא מאובטחים, משתמשים בכלים לא מורשים, ושם בדיוק מתרחשות הדליפות הגדולות. תופעה זו נקראת "Shadow AI" (AI בצללים). זה קורה כי הם רוצים להיות יעילים, אבל אין להם כלים.

הדרך היחידה והאפקטיבית למנוע את זה היא לא לאסור על AI (כי זה בלתי אפשרי לאכוף), אלא לספק לעובדים אלטרנטיבה בטוחה, מאושרת ומנוהלת.

טיפ למנהלים: הדרכה היא הכלי הכי חזק שלכם

טכנולוגיה זה לא מספיק. אנחנו תמיד ממליצים ללקוחות שלנו לבצע הדרכה עונתית לעובדים על "היגיינת AI". להסביר מה מותר ומה אסור, איזה מידע אפשר לשים בבוט ואיזה חייב להישאר במחשב המקומי. המודעות של העובדים היא חומת האש הטובה ביותר.

שאלות נפוצות (FAQ)

ש: האם אפשר להתקין את המודל אצלי בשרת (On-Premise)? ת: כן. לארגונים ביטחוניים (Enterprise), אנו מציעים התקנת מודלים מקומיים (כמו Llama 3) שרצים פיזית על השרתים שלכם ולא יוצאים לאינטרנט בכלל.

ש: האם העובדים שלי ידעו להשתמש בכלי האבטחה? ת: זה שקוף עבורם. מנגנוני ההגנה רצים ברקע. העובד שואל שאלה, ההגנות עובדות, והוא מקבל תשובה. אין צורך בידע טכני.

ש: האם OpenAI ישתמשו במידע שלי לאימון? ת: חד משמעית לא. בחוזה ה-Enterprise שלנו, יש התחייבות משפטית שלא יעשה שימוש במידע שלכם ושתישמר הפרדה מוחלטת (Siloing).

ש: מה קורה במקרה של תקיפת סייבר? ת: אנו משתמשים בתשתיות הענן החזקות בעולם (AWS/Google Cloud) עם הגנות מתקדמות (WAF, DDoS Protection) שמבטיחות שרידות וזמינות גם תחת מתקפה.

ש: האם יש לי גיבוי לשיחות? ת: כן, כל השיחות נשמרות בלוגים מוצפנים בצד הארגון (אם תבחרו בכך) לצורכי בקרה והפקת לקחים, כך שתוכלו תמיד לחזור אחורה ולראות מה נאמר.

ש: האם אתם עומדים בתקן GDPR האירופאי? ת: בהחלט. כל המערכות שלנו בנויות בסטנדרט פרטיות מחמיר (Privacy by Design), כולל מנגנוני "הזכות להישכח" ומחיקת נתונים לבקשת משתמש.

בטיחות בונה אמון (Trust is Currency) – סיכום

לסיכום, אבטחת מידע היא לא מקום לעיגול פינות. כשאתם בוחרים בפתרון AI ארגוני אמיתי, אתם לא רק מגינים על עצמכם, אלא משדרים ללקוחות שלכם שאתם רציניים, מקצועיים ומכבדים את הפרטיות שלהם. זה הבסיס לכל מערכת יחסים עסקית בעידן החדש.

בעידן שבו כולם חוששים לפרטיות שלהם, ולומדים על פריצות סייבר בחדשות כל שני וחמישי, היכולת שלכם להגיד ללקוחות ולמשקיעים: "המידע שלכם מוגן אצלנו בתקני האבטחה המחמירים ביותר של 2026" היא לא רק דרישה טכנית – היא יתרון תחרותי שיווקי אדיר. זה בונה אמון, ואמון שווה מכירות.

אל תתנו לפחד לשתק אתכם. אבטחת מידע היא לא חסם לחדשנות, היא התשתית החזקה שמאפשרת אותה.

רוצים לבנות תשתית AI מאובטחת בלי לקחת סיכונים מיותרים? התייעצו עם מומחי הסייבר שלנו.

Michael Romm

מיכאל, מייסד שותף ב-Whale Group, מוביל אסטרטגיה עסקית ושיווקית. מומחה לדאטה (SQL, Python) ופיתוח פתרונות אוטומציה ו-AI לעסקים.