Безопасность ИИ: как дать доступ к данным, не раскрывая секреты

Кошмар каждого IT-директора: ваши секреты — у конкурентов

Вы, наверное, слышали знаменитую и пугающую историю, которая гуляла по LinkedIn и в СМИ: инженер-программист крупной технологической компании (например, Samsung или Amazon) просто хотел оптимизировать свою работу. Он загрузил в ChatGPT фрагмент проприетарного кода, связанного с разработкой будущих чипов, или, возможно, протокол конфиденциального заседания совета директоров, и попросил бота с полной невинностью: «суммируй мне это», «найди баг» или «составь ответное письмо».

Чего он не знал — в тот момент он отправил самый тщательно охраняемый коммерческий секрет компании на публичные серверы в США. На следующий день эта информация была обработана и стала (теоретически) частью базы знаний системы, и потенциально могла появиться в ответах другим пользователям — включая его прямых конкурентов, задавших похожие вопросы.

Это главный страх (и обоснованный) генеральных директоров, финансовых директоров, юристов и B2B-организаций, рассматривающих внедрение AI-технологий: «Если я подключу бота к своей CRM, будет ли OpenAI или Google читать мой список клиентов? Утекут ли мои финансовые данные? Рискую ли я своими патентами?»

Краткий ответ: это очень сильно зависит от того, как вы это делаете. Если ваши сотрудники используют бесплатную версию ChatGPT пиратским и партизанским образом — у вас серьёзная проблема с безопасностью данных. Но если вы строите корпоративное решение, управляемое через API (программный интерфейс) — вы можете быть полностью в безопасности. Давайте глубоко разберём это критическое различие.

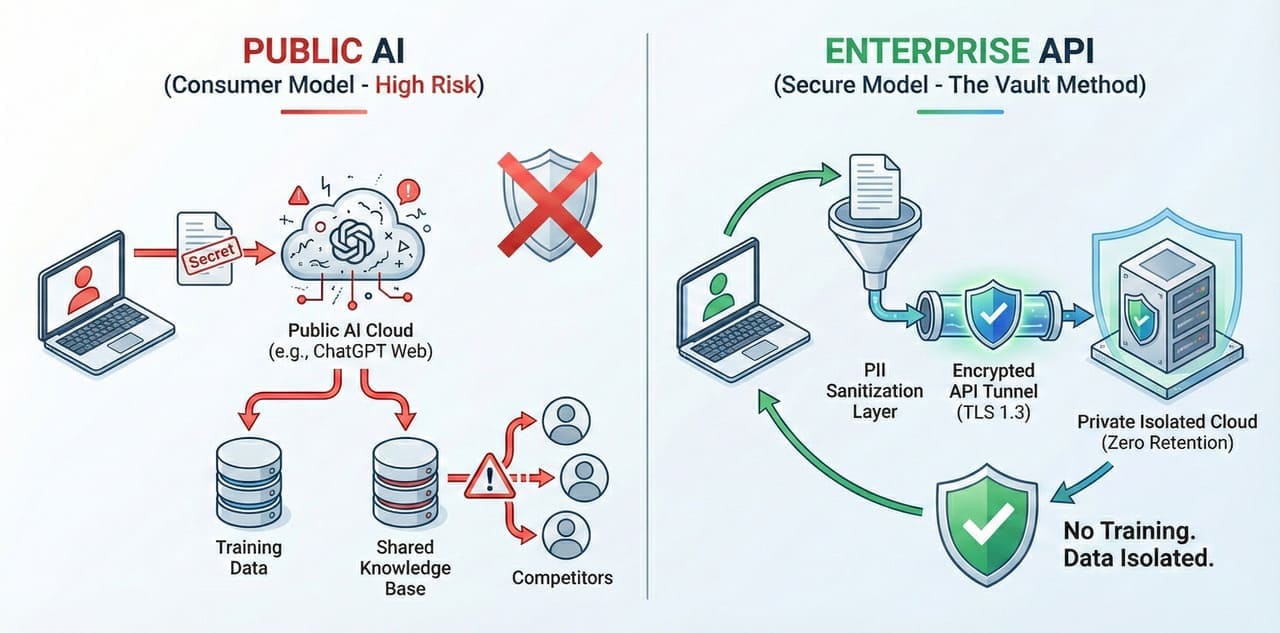

Разница между «Public AI» и «Enterprise AI»

Чтобы понять безопасность данных в 2026 году и правильно управлять рисками, необходимо различать два совершенно отдельных мира:

1. Потребительская модель (Consumer Model — Public)

Это то, что знает большинство людей (ChatGPT, Claude.ai, Gemini в веб-версии). Вы заходите на сайт, пишете вопрос, и информация хранится на серверах. Бизнес-модель этих компаний частично основана на том, что ваша информация помогает обучать и улучшать будущие модели (Training Data).

- Уровень безопасности: Относительно низкий по корпоративным стандартам.

- Конфиденциальность: Информация используется для обучения модели.

- Кому подходит: Для написания поздравлений с днём рождения, рецептов, идей для путешествий, общих вопросов. Категорически запрещено использовать для анализа финансовых отчётов, юридических контрактов или медицинской информации.

2. Корпоративная модель (API Enterprise Model)

Когда мы в Whale Group строим вам агента-консультанта или любое другое решение, мы не используем открытый веб-сайт. Мы используем прямой, частный и зашифрованный «канал» связи с серверами (API). Согласно юридически обязывающим Условиям использования (Terms of Service) крупных AI-провайдеров (OpenAI Enterprise, Google Vertex AI, Azure OpenAI) при использовании через API:

- Zero Data Retention (нулевое хранение данных): Ваша информация не хранится на серверах провайдера после завершения обработки.

- No Training (без обучения): Ваша информация не используется для обучения будущей модели компании. Она ваша и только ваша.

- Полное разделение (Isolation): Информация проходит, обрабатывается и возвращается вам. Она не входит в «общий мозг» ИИ и не утекает к другим пользователям.

Хотите проконсультироваться?

Мы поможем вам выбрать, создать и внедрить идеальное AI-решение для вашего бизнеса. Оставьте контакты, и мы вам перезвоним.

Наша архитектура безопасности: «Метод сейфа»

В Tech Consulting Whale Group мы не берём на себя ненужные риски. Мы реализуем многоуровневую архитектуру безопасности (Defense in Depth) для защиты ваших активов и обеспечения соответствия строгим стандартам (GDPR, SOC2). Мы называем это «Методом сейфа»:

- Уровень фильтрации (Sanitization Layer — PII Redaction): Прежде чем вопрос клиента вообще достигнет ИИ, он проходит через умный алгоритм фильтрации (Redactor), который автоматически удаляет конфиденциальные идентифицирующие данные (PII — Personally Identifiable Information), такие как номера кредитных карт, паспортные данные, частные адреса или пароли, если они не нужны для ответа. Таким образом, конфиденциальная информация остаётся на вашем сервере и никогда не выходит в мир.

- Ограниченный и умный контекст (RAG — Retrieval Augmented Generation): Бот не «скачивает всю CRM» или всю базу данных. Он работает хирургически. Он получает точечный доступ («Read Only») только к конкретному фрагменту информации, релевантному для данного конкретного вопроса в данный момент. Например, только к статусу заказа текущего клиента, а не ко всем заказам в компании. Это значительно минимизирует поверхность атаки.

- Сквозное шифрование (Encryption): Вся коммуникация, от вашего сайта до сервера и обратно, зашифрована по стандарту TLS 1.3 (тот же стандарт шифрования, используемый банками, финансовыми учреждениями и силовыми структурами). Даже если кто-то перехватит коммуникацию по пути, он увидит только бессмысленную последовательность символов («тарабарщину»).

Реальная опасность — не ИИ, а «теневой ИИ» (Shadow AI)

Исследования показывают, что наибольший риск для вашей организации сегодня — это не организованное внедрение ИИ, а противоположное — игнорирование. Пока вы раздумываете и ждёте, ваши сотрудники уже используют ИИ «под радаром», чтобы облегчить свою нагрузку. Они копируют таблицы Excel в незащищённые бесплатные боты, используют несанкционированные инструменты, и именно там происходят крупные утечки. Это явление называется «Shadow AI» (теневой ИИ). Это происходит потому, что они хотят быть эффективными, но у них нет инструментов.

Единственный эффективный способ предотвратить это — не запрещать ИИ (потому что это невозможно обеспечить), а предоставить сотрудникам безопасную, одобренную и управляемую альтернативу.

Совет для руководителей: обучение — ваш самый мощный инструмент

Технологии недостаточно. Мы всегда рекомендуем нашим клиентам проводить ежеквартальное обучение сотрудников по «гигиене ИИ». Объяснять, что разрешено, а что нет, какую информацию можно вводить в бот, а какая должна оставаться на локальном компьютере. Осведомлённость сотрудников — лучший брандмауэр.

Часто задаваемые вопросы (FAQ)

В: Можно ли установить модель на собственный сервер (On-Premise)? О: Да. Для корпоративных организаций мы предлагаем установку локальных моделей (например, Llama 3), которые работают физически на ваших серверах и вообще не выходят в интернет.

В: Будут ли мои сотрудники знать, как пользоваться инструментами безопасности? О: Для них это прозрачно. Механизмы защиты работают в фоновом режиме. Сотрудник задаёт вопрос, защиты срабатывают, и он получает ответ. Технические знания не требуются.

В: Будет ли OpenAI использовать мои данные для обучения? О: Категорически нет. В нашем корпоративном контракте есть юридическое обязательство о том, что ваши данные не будут использоваться и будет поддерживаться полное разделение (Siloing).

В: Что происходит в случае кибератаки? О: Мы используем сильнейшие облачные инфраструктуры в мире (AWS/Google Cloud) с продвинутыми средствами защиты (WAF, DDoS Protection), обеспечивающими устойчивость и доступность даже под атакой.

В: Есть ли у меня резервная копия разговоров? О: Да, все разговоры хранятся в зашифрованных журналах на стороне организации (если вы выберете это) для целей контроля и извлечения уроков, так что вы всегда можете вернуться назад и посмотреть, что было сказано.

В: Соответствуете ли вы европейским стандартам GDPR? О: Безусловно. Все наши системы построены по строгим стандартам конфиденциальности (Privacy by Design), включая механизмы «права на забвение» и удаление данных по запросу пользователя.

Безопасность строит доверие — итог

Подводя итог, безопасность данных — это не место для срезания углов. Когда вы выбираете настоящее корпоративное AI-решение, вы не только защищаете себя — вы сигнализируете своим клиентам, что вы серьёзны, профессиональны и уважаете их конфиденциальность. Это основа каждых деловых отношений в новую эпоху.

В эпоху, когда все обеспокоены своей конфиденциальностью и узнают о кибервзломах в новостях через день, ваша способность сказать клиентам и инвесторам: «Ваша информация защищена у нас по строжайшим стандартам безопасности 2026 года» — это не просто техническое требование, это огромное маркетинговое конкурентное преимущество. Это строит доверие, а доверие равно продажам.

Не позволяйте страху парализовать вас. Безопасность данных — это не барьер для инноваций, это прочный фундамент, который их обеспечивает.

Michael Romm

Михаил — сооснователь Whale Group, руководит бизнес- и маркетинговой стратегией. Эксперт в области данных (SQL, Python) и разработки решений по автоматизации и AI для бизнеса.